KI-GESTÜTZTE DOKUMENTATION

Was möchten Sie wissen?

Verbesserung Ihres Modells im Laufe der Zeit

Ihre Inspektion ist im Einsatz. Wie sorgen Sie nun dafür, dass sie weiterhin zuverlässig funktioniert, wenn sich Bedingungen ändern, neue Defektarten auftreten oder sich Spezifikationen weiterentwickeln?

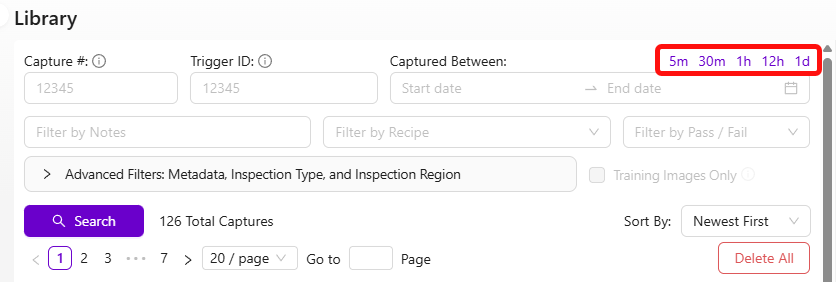

Die Library: Ihr Werkzeug zur kontinuierlichen Verbesserung

Jede von der Kamera erfasste Aufnahme wird in der Library gespeichert – zusammen mit der KI-Vorhersage und dem Confidence-Wert. Das ist Ihre Goldmine für Verbesserungen.

Finden Sie heraus, wo die KI falsch lag

- Gehen Sie zur Library

- Durchsuchen Sie aktuelle Aufnahmen

- Achten Sie auf zwei Dinge:

- Misses: Bilder, bei denen die KI-Vorhersage eindeutig falsch ist (Checkbox oben links bei jedem Thumbnail)

- Vorhersagen mit niedriger Confidence: Scrollen Sie auf einem Bild nach unten, um die Confidence-Werte zu sehen. Niedrige Confidence = die KI war unsicher

In einem kleinen Datensatz hat ein einzelnes falsches Label einen überproportionalen Einfluss. Mit nur 5 Trainingsbildern verfälscht ein Fehlerlabel 20 % Ihrer Daten. Überprüfen Sie vor dem erneuten Training stets jedes Label doppelt – besonders bei kleinen Datensätzen.

Erneutes Training mit gezielten Daten

- Wählen Sie die Bilder aus, bei denen die KI falsch lag oder unsicher war

- Klicken Sie auf "Add to Active Recipe Train Set"

- Korrigieren Sie bei Bedarf die Labels

- Klicken Sie auf Retrain

Konzentrieren Sie sich auf Misses und Aufnahmen mit niedriger Confidence, nicht auf zufällige neue Daten. Das ist der effizienteste Weg zur Verbesserung.

Wenn Sie genau sehen möchten, was die KI für ein bestimmtes Bild vorhergesagt hat, laden Sie das gespeicherte JPEG in den Metadata Viewer hoch. OV-Kameras betten Vorhersageergebnisse, Confidence-Werte und Kameraeinstellungen direkt in jedes aufgenommene Bild ein.

Mit wachsendem Datensatz wird die manuelle Überprüfung jedes Labels unpraktikabel. Haystack ermöglicht es Ihnen, Ihre Trainingsdaten visuell zu untersuchen, ähnliche Bilder zu clustern und Labels schnell zu identifizieren, die nicht passen. Führen Sie es regelmäßig aus, um Ihren Datensatz sauber zu halten.

Workflow zur Verbesserung des Classifiers

- Library-Bilder prüfen → Fehler und Vorhersagen mit niedriger Confidence finden

- Diese zum Trainingsdatensatz hinzufügen

- Bei Bedarf neu labeln

- Erneut trainieren

- Haystack verwenden, um Ihre Daten visuell zu untersuchen und fehlgelabelte Bilder in großem Umfang zu finden

Workflow zur Verbesserung des Segmenters

Segmenter benötigen mehr Zeit zum Labeln (pixelgenaue Annotation), daher gibt es eine Abkürzung:

- Importieren Sie Problembilder in das Segmentation-Recipe

- Klicken Sie auf Generate Predictions, damit das Modell die neuen Bilder so gut wie möglich vorab labelt

- Korrigieren Sie die Vorhersagen, anstatt von Grund auf neu zu labeln (viel schneller)

- Erneut trainieren

False Positives in der Segmentierung reduzieren

Wenn Ihr Segmenter viele kleine zufällige Blobs erkennt, die dort nicht hingehören, stehen Ihnen zwei wirkungsvolle Werkzeuge zur Verfügung: das Herausfiltern kleiner Blobs aus der Pass/Fail-Logik und das Training des Modells, damit es besser versteht, wie „normal" aussieht.

Kleine Blobs mit einem Mindestgrößen-Schwellenwert herausfiltern

Die schnellste Lösung besteht darin, dem System zu sagen, dass es Blobs unterhalb einer bestimmten Pixelfläche ignorieren soll. Kleine Rausch-Blobs sind fast immer winzig im Vergleich zu echten Defekten, sodass ein Größenfilter sie eliminiert, ohne Ihre tatsächliche Erkennung zu beeinträchtigen.

Im Basic Mode (IO Logic): Stellen Sie den Schwellenwert für die minimum blob area in den Pass/Fail-Einstellungen ein. Jeder Blob, der kleiner als diese Pixelanzahl ist, wird vollständig ignoriert. Beginnen Sie mit einem Wert von etwa 50 Pixeln und erhöhen Sie ihn, bis das Rauschen verschwindet, echte Defekte aber weiterhin auslösen.

Im Advanced Mode (Node-RED): Filtern Sie Blobs in Ihrem Function Node nach blob.pixel_count. Beispielsweise, um alle Blobs unter 50 Pixeln zu ignorieren:

const minBlobSize = 50;

const allBlobs = msg.payload.segmentation.blobs;

const realBlobs = allBlobs.filter(blob => blob.pixel_count >= minBlobSize);

const results = realBlobs.length <1; // Pass if no real blobs remain

msg.payload = results;

return msg;

Passen Sie den Wert minBlobSize an Ihre Anwendung an. Schauen Sie sich die Pixelzahlen Ihrer Rausch-Blobs im Vergleich zu echten Defekten in der Debug-Ausgabe an, um den richtigen Schwellenwert zu finden.

Gute Bilder zum Trainingsdatensatz hinzufügen

Das ist die wirksamste Einzelmaßnahme, um False-Positive-Erkennungen zu reduzieren – und sie wird am häufigsten übersehen.

Das Problem: Wenn Sie nur mit Bildern trainiert haben, die Defekte enthalten, hat das Modell nie gelernt, wie ein einwandfreies Teil aussieht. Es beginnt, „Defekte" in normaler Oberflächentextur, Lichtverläufen und kleinen Variationen zu sehen – all den kleinen zufälligen Blobs, die Sie bekämpfen.

So beheben Sie das Problem:

- Gehen Sie zur Library und suchen Sie Bilder von guten Teilen – saubere Oberflächen ohne Defekte

- Fügen Sie diese Bilder zum Trainingsdatensatz hinzu (Add to Active Recipe Train Set)

- Wählen Sie in der Labeling-Ansicht die ROIs aus, fügen Sie aber keine Defekt-Annotationen hinzu. Übernehmen Sie sie einfach so, wie sie sind, ohne Markierungen

- Trainieren Sie das Modell erneut

Indem Sie dem Modell Beispiele dafür zeigen, wie „normal" aussieht, bringen Sie ihm bei, gewöhnliche Oberflächenvariationen nicht mehr als Defekte zu markieren. Dies reduziert das Rauschen drastisch.

Richtlinien:

- Beginnen Sie mit 10–15 guten Bildern und trainieren Sie neu. Testen Sie die Ergebnisse

- Wenn das Rauschen weiterhin besteht, fügen Sie mehr hinzu. Streben Sie mindestens 20–30 gute Bilder gemischt mit Ihren Defektbildern an

- Das ist besonders wichtig, wenn Ihr ursprünglicher Trainingsdatensatz nur Bilder mit Defekten enthielt

- Stellen Sie sicher, dass die guten Bilder die Bandbreite der normalen Variation in der Produktion abdecken (unterschiedliche Beleuchtung, leichte Farbverschiebungen, Oberflächentexturen)

In neun von zehn Fällen, wenn jemand klagt, dass überall zufällige kleine Blobs erscheinen, liegt die Ursache darin, dass der Trainingsdatensatz keine guten Bilder enthält. Fügen Sie sie hinzu und trainieren Sie neu – die Verbesserung ist in der Regel sofort sicht- und spürbar.

Weitere Tipps zur Reduzierung von Rauschen

- Verbessern Sie die Beleuchtungskonsistenz. Ungleichmäßige Beleuchtung erzeugt Schatten und Glanzlichter, die das Modell mit Defekten verwechseln kann. Stellen Sie sicher, dass die integrierten LEDs richtig konfiguriert sind und externe Lichtquellen keine Blendungen oder wandernde Schatten verursachen

- Überprüfen Sie Ihre Template-Ausrichtung. Wenn der Aligner nicht gut funktioniert, verschiebt sich das ROI zwischen den Aufnahmen. Das Modell sieht jedes Mal andere Hintergrundbereiche, was das Rauschen erhöht. Stellen Sie sicher, dass die Ausrichtung stabil ist

- Iterieren Sie in kleinen Schritten. Fügen Sie 10–15 gute Bilder hinzu, trainieren Sie neu, testen Sie. Wiederholen Sie das, bis die Ergebnisse sauber sind. Das geht schneller, als 50 Bilder auf einmal einzuwerfen und auf das Beste zu hoffen

Die Philosophie

- Hören Sie nie auf zu iterieren. Die KI hat eine hohe Lernkapazität und verbessert sich mit 50, 100, sogar 500+ Bildern weiter

- Adressieren Sie Fehler gezielt. Fügen Sie nicht zufällig Daten hinzu. Fügen Sie die Fälle hinzu, in denen die KI Schwierigkeiten hat

- Prüfen Sie regelmäßig auf Fehl-Labels. Mit wachsendem Datensatz werden Fehl-Labels schwerer zu erkennen, schaden aber weiterhin der Genauigkeit

Beschleunigen Sie mit GenAI-Tools

Drei KI-gestützte Tools unter tools.overview.ai können Ihre Verbesserungszyklen drastisch beschleunigen:

- Defect Studio – Erzeugen Sie fotorealistische synthetische Defektbilder bis zu 10.000-mal schneller, als auf echte Defekte zu warten

- Integration Builder – Erstellen Sie produktionsreife Node-RED-Flows aus Beschreibungen in einfachem Englisch

- AI Expert Helper – Erhalten Sie 24/7 Experten-Support zu jeder Frage rund um die Kamera

Zusammen können diese drei Tools Ihre Inbetriebnahmezeit von Tagen auf Stunden reduzieren. Generieren Sie synthetische Trainingsdaten, anstatt auf echte Defekte zu warten, erstellen Sie Integrationen, indem Sie beschreiben, was Sie möchten, und erhalten Sie sofortige Expertenanleitung, ohne auf Support-Tickets warten zu müssen.