DOCUMENTACIÓN CON IA

¿Qué desea saber?

Paso 4: Entrenar Su Modelo de AI

Sus regiones de interés (ROIs) están configuradas. Ahora es momento de enseñarle a la AI cómo se ve lo "bueno" y lo "malo".

Las tres reglas cardinales del entrenamiento

Antes que nada, interiorice estas tres reglas. Se aplican ya sea que esté entrenando un clasificador o un segmentador, con 5 imágenes o 500.

Regla 1: Etiquete únicamente desde la imagen

Nunca observe la pieza física (ni la coloque bajo un microscopio) para decidir si es buena o mala. Si no puede ver el defecto en la imagen de la cámara, la AI no puede aprenderlo.

La AI no es magia. Solo puede trabajar con lo que la cámara ve. Si etiqueta una pieza como "defectuosa" basándose en algo que notó al tocarla o al hacer zoom bajo una lupa, pero la imagen de la cámara se ve bien, le está enseñando a la AI a ver algo que no está ahí.

Si no puede etiquetarla solo desde la imagen, regrese al paso de Instalación y corrija la configuración física: mejor lente, mejor iluminación, montaje más cercano, ángulo diferente.

Regla 2: Verifique sus etiquetas dos y tres veces

Los errores de etiquetado le pasan a todos; los ingenieros experimentados también los cometen. Pero una sola etiqueta incorrecta en un conjunto de datos pequeño puede destruir sus resultados.

Con 5 imágenes de entrenamiento, una etiqueta incorrecta corrompe el 20% de sus datos de entrenamiento. Eso es catastrófico.

Antes de cada ejecución de entrenamiento: Haga clic en Ver Todas las ROIs y verifique cada anotación. Esto es lo más fácil de corregir y lo de mayor impacto.

Regla 3: Comience con poco, itere rápido

No etiquete 50 imágenes y presione entrenar. En su lugar, cree un ciclo ajustado: Etiquete 10-15 imágenes por clase, entrene (aproximadamente 30 segundos), pruebe e intente romperlo, luego agregue datos específicos donde falle. Repita este ciclo 2-4 veces.

Este ciclo es su camino más rápido hacia un buen modelo.

Flujo de trabajo de entrenamiento paso a paso

1. Capture las imágenes iniciales de entrenamiento

Con su receta activa y las piezas fluyendo (o colocadas manualmente), capture imágenes. Necesita un mínimo de 10-15 imágenes por clase para comenzar.

Para una inspección simple de aprobado/rechazado:

- 10-15 imágenes de piezas buenas

- 10-15 imágenes de piezas defectuosas

2. Defina sus clases

Elija el tipo de modelo que está entrenando, luego lea las instrucciones correspondientes. El selector a continuación permanece sincronizado entre el Paso 2 y el Paso 3, y su elección se conserva en la URL para que sobreviva a una actualización o al compartirla.

- Classifier

- Segmenter

En la interfaz de etiquetado, agregue las clases que cada tipo de inspección necesita. Conjuntos comunes de clases de clasificador:

- Aprobar / Fallar

- Presente / Ausente

- Bueno / Rayado / Agrietado

Manténgalo simple al principio. Siempre puede agregar clases más adelante.

En la interfaz de etiquetado, agregue clases para los defectos (o características) que desea que la AI enmascare. Conjuntos comunes de clases de segmentador:

- Defecto / Fondo

- Rayadura / Grieta / Mancha

- Primer plano / Fondo

Mantenga la lista de clases corta al principio. Cada clase necesita su propio color de pincel y sus propios ejemplos etiquetados, por lo que agregar más clases desde el inicio multiplica su trabajo de etiquetado.

3. Etiquete las imágenes

- Classifier

- Segmenter

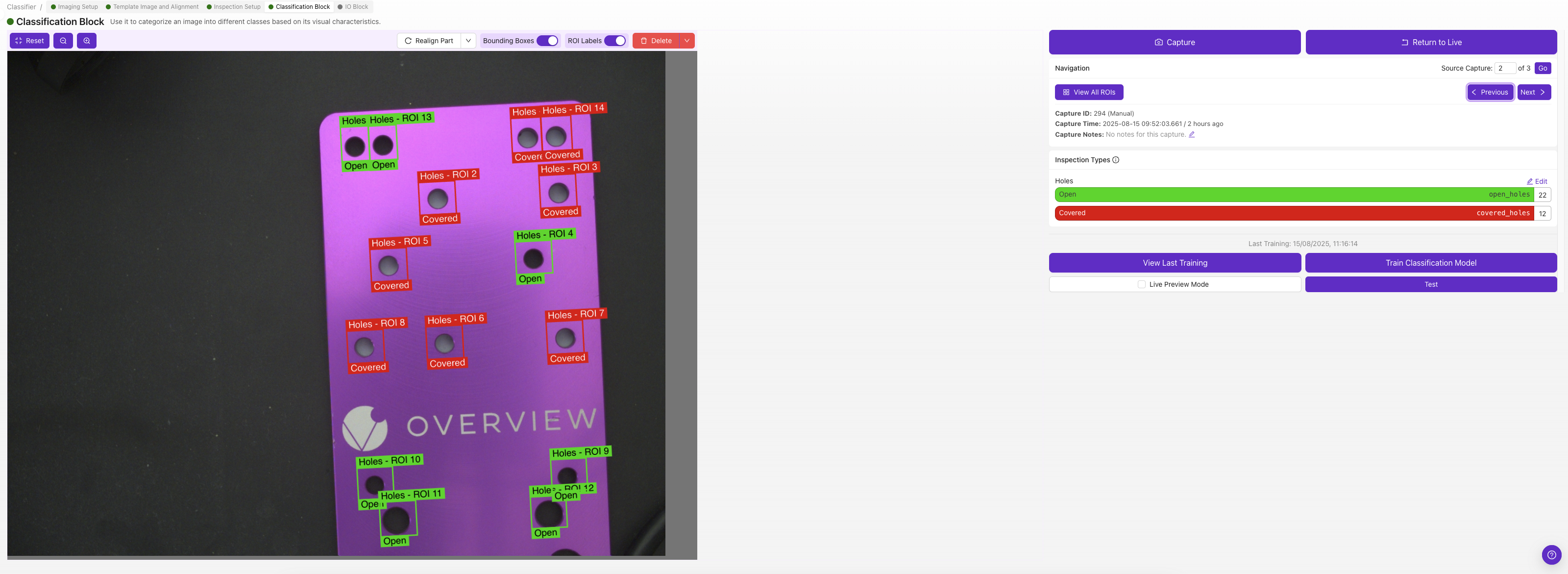

Cada ROI obtiene su propia clase de clasificación — seleccione la clase que describa ese ROI en esa imagen (por ejemplo, "aprobado" o "rechazado").

Si no está seguro de si usar Clasificación o Segmentación, comience con Clasificación. Es mucho más rápido para etiquetar y es bueno para la mayoría de los escenarios de aprobado/rechazado. Consulte Classifier vs. Segmenter para obtener orientación.

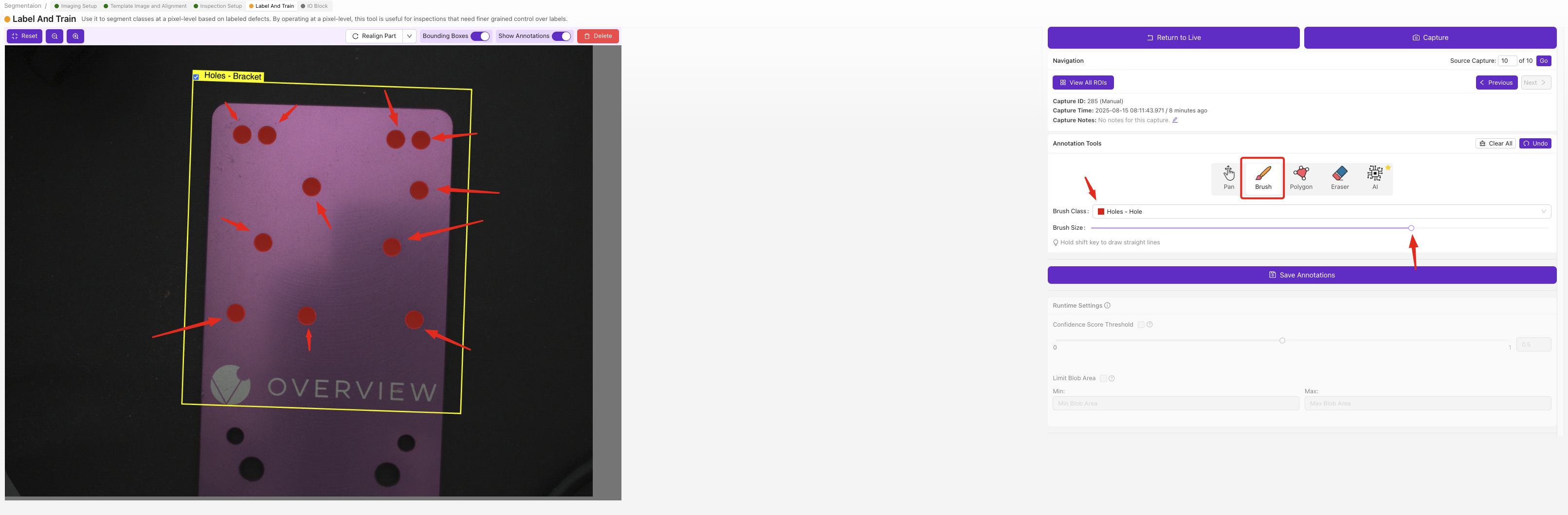

Para cada ROI en cada imagen, use la herramienta de pincel para pintar las áreas defectuosas píxel por píxel. Las regiones pintadas son lo que la AI aprende a detectar — todo lo que no pinte se trata como fondo.

Las etiquetas del segmentador requieren trabajo de pincel a nivel de píxel, lo cual es más lento que las selecciones del menú desplegable del clasificador, pero le da mapas de defectos precisos con ubicación y forma. Comience con un conjunto pequeño de defectos claramente definidos, y solo agregue más clases una vez que su primer modelo esté funcionando.

4. Entrene el modelo

- Classifier

- Segmenter

Haga clic en Entrenar. El clasificador ofrece dos modos de entrenamiento:

- Modo rápido — aproximadamente 30 segundos a un minuto. Mejor para iteración rápida durante la configuración, verificación de cordura de sus etiquetas y piezas fáciles/bien separadas. La precisión es menor que en el modo de producción, pero le permite ver la señal rápidamente.

- Modo de producción — toma más tiempo pero produce un modelo notablemente más preciso. Siempre use el modo de producción antes de desplegar a la línea. Para piezas complicadas, defectos difíciles de distinguir o cualquier cosa en la que confíe en producción, el modo de producción es la respuesta correcta.

Un buen ritmo: itere en modo rápido mientras está limpiando etiquetas y agregando datos, luego ejecute Producción una vez que el resultado se vea bien — y nuevamente antes de desplegar.

Haga clic en Entrenar. La segmentación solo tiene un modo de entrenamiento — Producción — porque las máscaras a nivel de píxel necesitan el paso de entrenamiento más exhaustivo para ser confiables. El tiempo de entrenamiento escala con el número de imágenes y el número de ROIs que haya etiquetado, por lo que un conjunto inicial pequeño (10-15 imágenes por clase) se entrena en unos minutos; los conjuntos de datos más grandes toman más tiempo.

No hay una opción de verificación de cordura "rápida" aquí, así que asegúrese de que sus etiquetas estén limpias antes de entrenar (use Ver todos los ROIs para revisar cada máscara).

Los segmentadores solo aprenden el tamaño y la textura de los defectos que se les mostraron. Si su conjunto de entrenamiento no tiene más que pequeños contaminantes y luego llega una pieza grande de la misma clase de defecto en producción, el modelo solo delineará las partes del defecto grande que se asemejen a los ejemplos pequeños — dejando la mayor parte sin cubrir. La máscara se ve irregular o solo marca los bordes y esquinas del defecto real.

Solución: incluya ejemplos de entrenamiento que abarquen toda la gama de tamaños de defectos que espera en la línea. Un puñado de capturas de contaminantes grandes junto con los pequeños suele ser suficiente. El mismo principio se aplica a la variación de textura y color — entrene con la variedad que verá.

¿No tiene muestras de defectos grandes? Use el Defect Creator Studio para generar imágenes sintéticas de entrenamiento del mismo defecto en diferentes tamaños, ubicaciones y orientaciones — sin necesidad de esperar a que un contaminante grande real baje por la línea.

5. Probar con Vista Previa en Vivo

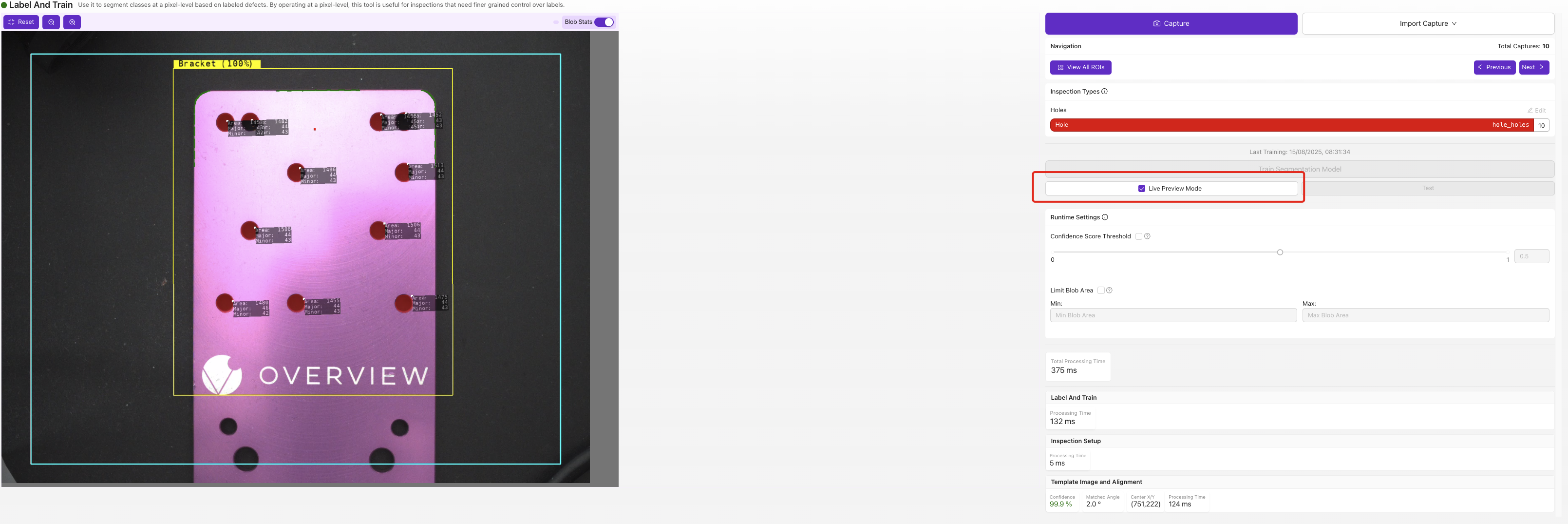

Haga clic en Modo de Vista Previa en Vivo y haga pasar piezas. Observe los resultados:

- ¿Está acertando en los casos fáciles?

- ¿Dónde tiene dificultades?

- ¿Cuáles son los casos límite?

Intente romperlo. Encuentre los casos donde falla. Estas fallas son su hoja de ruta para mejorar.

- Classifier

- Segmenter

El panel de Prueba muestra la clase predicha y la puntuación de confianza para cada ROI. Ejecute algunas capturas y busque veredictos de baja confianza (frecuentemente por debajo del 70%) — esos son sus casos límite y las piezas que más vale la pena etiquetar a continuación.

La Vista Previa en Vivo superpone la máscara de defecto predicha directamente sobre la imagen. Esté atento a máscaras demasiado pequeñas, demasiado grandes o que aparezcan donde no hay un defecto real — esos son los modos de falla que abordará con la siguiente ronda de datos etiquetados.

6. Agregar datos específicos

No agregue imágenes nuevas al azar. Agregue imágenes que se dirijan específicamente a los modos de falla que encontró:

- Si confunde rayones con reflejos, agregue más ejemplos de ambos

- Si pasa por alto defectos pequeños, agregue más imágenes de defectos pequeños

- Si falla en piezas ubicadas en las esquinas, agregue más ejemplos de esquinas

7. Reentrenar y volver a probar

Repita los pasos 4-6 de dos a cuatro veces. Cada iteración debería mejorar la precisión. Para un recorrido más detallado — incluyendo cómo agregar nuevas imágenes a un modelo existente sin perder su entrenamiento previo — consulte Añadiendo Datos y Reentrenamiento.

Aumentos de datos: enseñando a la AI a manejar la variación

Los aumentos de datos modifican aleatoriamente sus imágenes de entrenamiento durante el proceso de entrenamiento — ajustando el brillo, agregando rotación, modificando el contraste, etc. Cada imagen se alimenta a la AI cientos de veces con aumentos de datos ligeramente diferentes, pero la etiqueta permanece igual. Así es como se hace que un modelo sea robusto ante las condiciones del mundo real sin tener que capturar un ejemplo de cada variación posible.

Qué activar por defecto

Una pequeña cantidad de variación de brillo casi siempre vale la pena activar — incluso la fábrica más controlada tiene luces cenitales que parpadean, sombras que cambian durante el turno y una deriva menor de LED con el tiempo. El aumento de datos de brillo hace que el modelo sea resistente a todo eso prácticamente sin costo.

Rotación: útil, pero cuide la forma del ROI

El aumento de datos por rotación es excelente si sus piezas realmente pueden llegar en diferentes ángulos (tornillos sueltos en una banda transportadora, piezas colocadas a mano, cualquier cosa no sujeta en un dispositivo de fijación). Pero interactúa con la forma del ROI:

- ROI cuadrado: el aumento de datos por rotación funciona limpiamente — la imagen rotada aún cabe dentro del cuadro del ROI.

- ROI no cuadrado en un clasificador: la rotación puede recortar la imagen. Cuando un ROI alto y estrecho se rota 45°, las esquinas del contenido rotado quedan fuera del cuadro y el modelo se entrena con una imagen parcial. Si su pieza puede rotar, ya sea haga el ROI cuadrado o confíe en el alineador para manejar la rotación previamente, de modo que no necesite el aumento de datos por rotación aquí.

- Segmentador: aplica la misma preocupación de recorte, pero la segmentación es menos sensible porque aprende de máscaras de píxeles en lugar de la forma completa del ROI.

Cuándo NO usar un aumento de datos específico

La regla general: no aplique aumentos de datos a la propiedad que está inspeccionando. Si está intentando detectar orientación, el aumento de rotación enseñará al modelo que las piezas al revés siguen siendo "buenas".

- ¿Inspeccionando la consistencia del color? No use aumento de saturación.

- ¿Inspeccionando desenfoque/enfoque? No use aumento de motion blur.

- ¿Inspeccionando la orientación? No use aumento de rotación (y probablemente tampoco use el alineador).

La diversidad de datos importa

Sus datos de entrenamiento deben representar la gama completa de lo que la AI verá en producción:

- Diferentes horas del día (si la iluminación varía)

- Diferentes lotes de piezas (el acabado superficial puede variar ligeramente)

- Piezas en diferentes posiciones dentro del cuadro

- Casos fáciles y difíciles

Enfóquese en los casos más difíciles. Si sus datos de entrenamiento incluyen las 10 piezas más difíciles de clasificar, entonces el 90% de las piezas fáciles serán triviales para la AI.

Alta capacidad de aprendizaje

La AI de la cámara OV está diseñada para seguir mejorando con más datos. A diferencia de muchos sistemas de AI que se estancan después de 20 imágenes, este modelo sigue mejorando con 50, 100, incluso más de 500 imágenes. La mayoría de las inspecciones funcionan muy bien con 5-10 imágenes, pero si tiene un problema complejo de múltiples defectos, no dude en seguir agregando datos.

Acelere con datos sintéticos: Defect Studio

¿Qué pasa si necesita entrenar para un defecto que rara vez ve? ¿Un tornillo faltante que tendría que quitar intencionalmente, un rayón que tendría que crear, una grieta que ocurre una vez cada mil piezas? Esperar meses para recolectar suficientes ejemplos no es práctico.

El OV Auto-Defect Creator Studio en tools.overview.ai resuelve esto. Genera imágenes sintéticas fotorrealistas de defectos, hasta 10,000 veces más rápido que esperar a que aparezcan defectos reales en la línea de producción.

Cómo funciona: 5 pasos simples

- Cargue una imagen buena de su pieza

- Marque el área donde debe aparecer el defecto

- Describa el defecto en inglés sencillo (p. ej., "deep scratch across the surface" o "missing solder joint")

- Genere las variaciones del defecto (la AI crea resultados fotorrealistas)

- Exporte las imágenes sintéticas directamente a su conjunto de entrenamiento

Por qué funcionan los datos sintéticos

Las imágenes generadas no son simplemente artefactos "pegados". Son variaciones fotorrealistas que coinciden con su iluminación real, ángulo de cámara y superficie de la pieza. La AI comprende la física de cómo se ven los defectos bajo sus condiciones de imagen específicas.

Casos de uso:

- Defectos raros: Entrene para modos de falla que nunca (o rara vez) ha visto

- Lanzamientos de nuevos productos: Cree una inspección antes de que la primera pieza defectuosa salga de la línea

- Casos límite: Genere ejemplos en el límite para mejorar el límite de decisión de la AI

- Aumento de datos: Complemente conjuntos de datos pequeños con variedad sintética

Véalo en acción

El mejor enfoque: entrene primero con sus 3-5 imágenes reales iniciales, identifique dónde tiene dificultades la AI, luego use Defect Studio para generar ejemplos sintéticos dirigidos a esos modos de falla específicos. Los datos reales enseñan la línea base; los datos sintéticos llenan los vacíos.

Lista de verificación de entrenamiento

Antes de continuar, confirme:

- Imágenes iniciales capturadas, mínimo 10-15 por clase

- Todas las etiquetas verificadas dos veces (Ver todas las ROIs)

- Entrenado y probado con Vista Previa en Vivo

- Modos de falla identificados y datos específicos agregados

- 2-4 iteraciones de etiquetar → entrenar → probar completadas

- Los resultados cumplen con las expectativas

¿Modelo entrenado y luciendo bien? Continúe al Paso 5: Configuración de Salidas.